Servers in stock

Checking availability...

-

由于其低延迟性能,TPU 非常适合推荐引擎和欺诈检测等实时应用。

TPU 经过精心设计,能够高效地训练 GPT-4 和 BERT 等复杂模型,从而显著降低训练时间和计算成本。

从气候模型到蛋白质模拟,TPU 为研究人员提供了突破性发现所需的速度和能力。

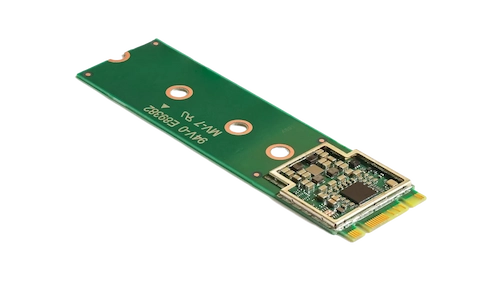

Coral M.2 加速器通过提供快速推理和极低的功耗,显著提升设备端机器学习性能。将其集成到您的系统中,即可在边缘实现高效的实时机器学习处理,从而降低延迟并减少对云资源的依赖。

Hailo-8 边缘 AI 处理器采用超紧凑封装,尺寸比一美分硬币还小(含内存),却能提供高达 26 TOPS 的运算能力。其神经网络优化架构支持在边缘设备上进行实时深度学习,同时功耗极低,是汽车、智慧城市和工业自动化应用的理想之选。这种高效的设计支持边缘端的高性能 AI,同时最大限度地降低能耗和总体成本。

TPU 专为处理矩阵密集型任务而设计,与传统 GPU 相比,可提供更快的训练和推理速度。

允许在多个单元上分布训练,从而实现大规模模型的有效扩展。

支持 TensorFlow、PyTorch(通过 OpenXLA)和 JAX 等流行的机器学习框架,确保与您现有的流程轻松集成。

TPU 与 Google Kubernetes Engine (GKE) 和 Vertex AI 集成,可轻松编排和管理 AI 工作负载。