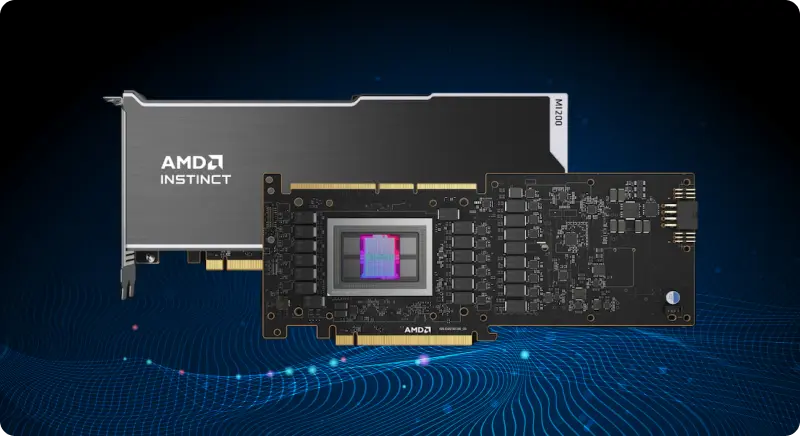

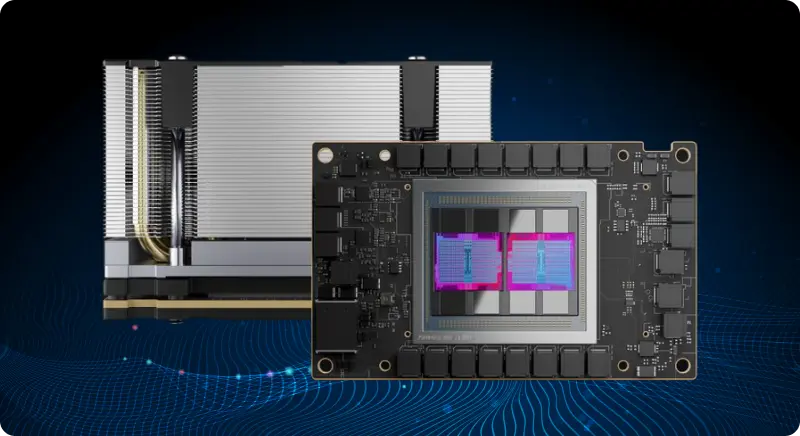

Massima capacità di elaborazione

L'architettura CDNA3 offre prestazioni di calcolo rivoluzionarie per l'addestramento del deep learning, la messa a punto di LLM e i carichi di lavoro di calcolo scientifico che richiedono la massima velocità di elaborazione.