débit de calcul maximal

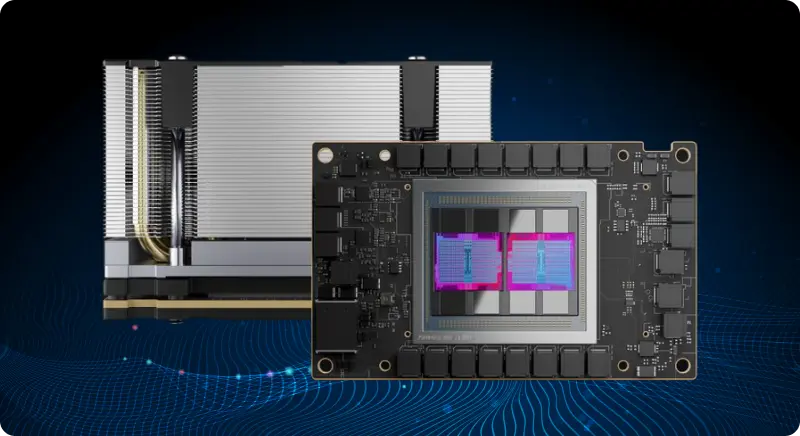

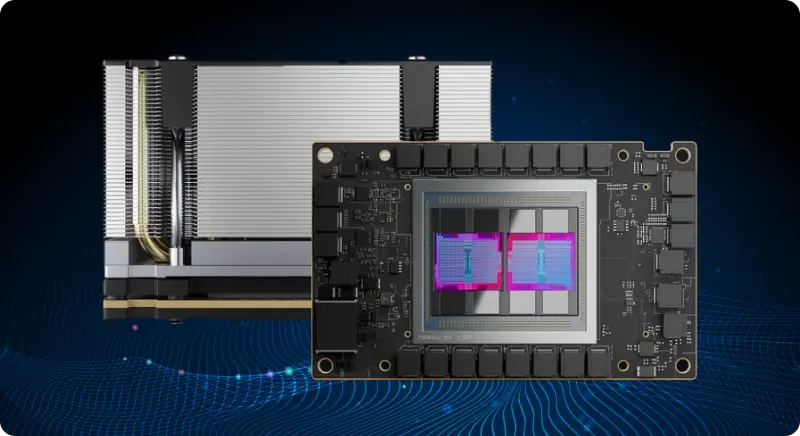

L'architecture CDNA3 offre des performances de calcul révolutionnaires pour l'entraînement de l'apprentissage profond, le réglage fin des LLM et les charges de travail de calcul scientifique nécessitant un débit maximal.

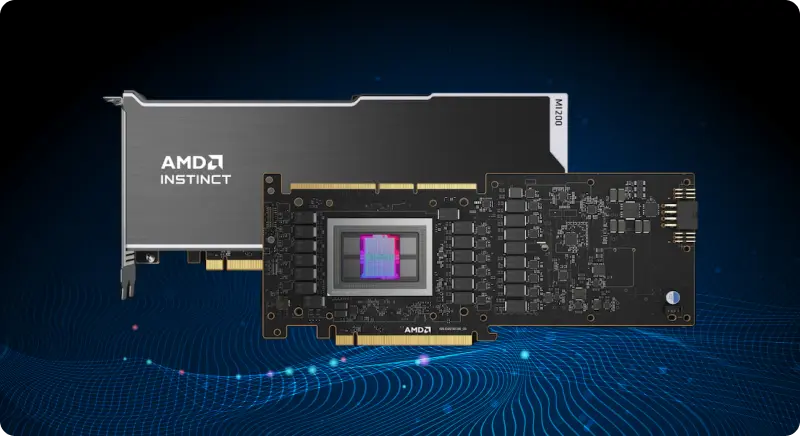

Déployez des serveurs bare metal HPE de qualité professionnelle, équipés d'accélérateurs AMD Instinct, pour les charges de travail d'apprentissage automatique, d'inférence LLM et de calcul haute performance.

Conçus pour l'intelligence artificielle, l'apprentissage automatique et le déploiement de modèles de langage complexes, les serveurs GPU AMD Instinct combinent une architecture de calcul CDNA3 avec des cœurs de processeur Zen 4 et 192 Go de mémoire unifiée HBM3 pour les applications intensives d'entraînement, d'inférence et de calcul haute performance en IA.

Accélérateurs de niveau entreprise basés sur l'architecture CDNA 2 pour le calcul exascale et les charges de travail d'IA

| MI210 | L40S | A100 | H100 | |

|---|---|---|---|---|

| Architecture GPU | CDNA 2.0 | Ada Lovelace | NVIDIA Ampere | Trémie |

| Mémoire GPU | 64 Go HBM2e | 48 Go GDDR6 | 80 Go HBM2e | 80 Go HBM3 |

| Bande passante de la mémoire GPU | 1638 Go/s | 864 Go/s | 1935 GB/s | 3352 Go/s |

| FP32 | 22,63 TFLOPS | 91,6 TFLOPS | 19,5 TFLOPS | 51 TFLOPS |

| Noyau Tensor TF32 | 312 TFLOPS | 366 TFLOPS | 312 TFLOPS | 756 TFLOPS |

| Noyau Tensor FP16/BF16 | 181 TFLOPS | 733 TFLOPS | 624 TFLOPS | 1513 TFLOPS |

| Pouvoir | Jusqu'à 300 W | Jusqu'à 350 W | Jusqu'à 400 W | Jusqu'à 350 W |

| Chargement... | Chargement... | Chargement... | Chargement... |

Trouvez les réponses aux questions fréquentes concernant le déploiement et l'exploitation des serveurs bare metal accélérés par GPU AMD Instinct pour l'entraînement de l'IA, l'inférence et les applications de calcul haute performance.