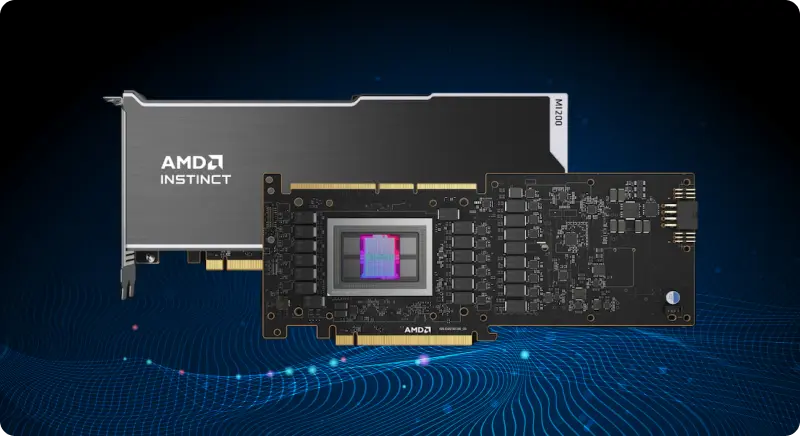

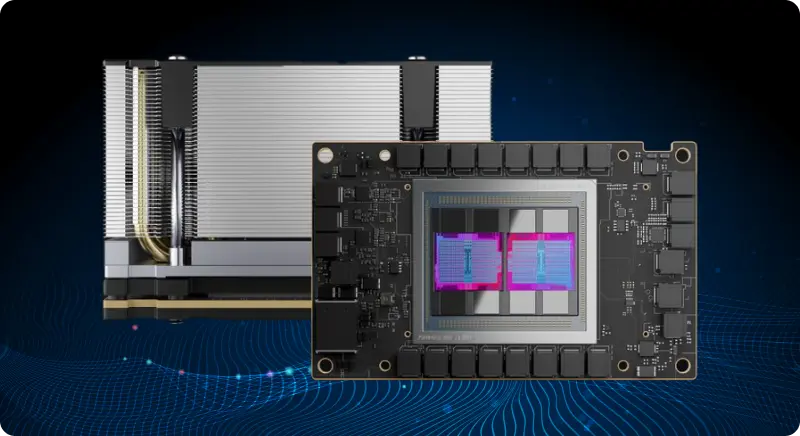

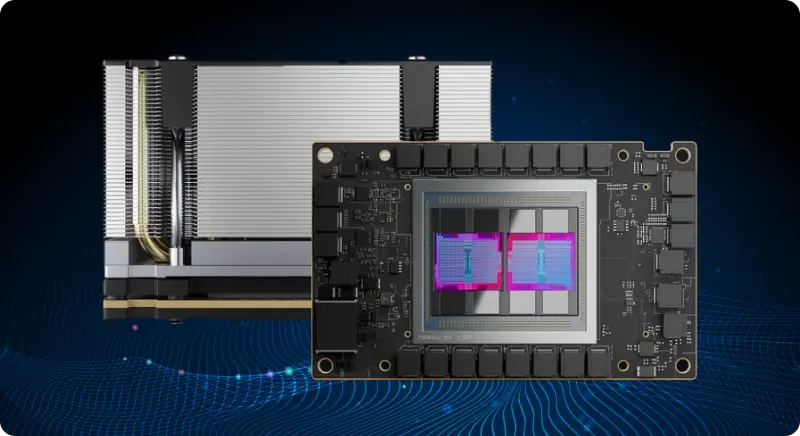

Rendimiento máximo de cálculo

La arquitectura CDNA3 ofrece un rendimiento informático revolucionario para el entrenamiento de aprendizaje profundo, el ajuste fino de LLM y las cargas de trabajo de computación científica que requieren el máximo rendimiento.