Maximaler Rechendurchsatz

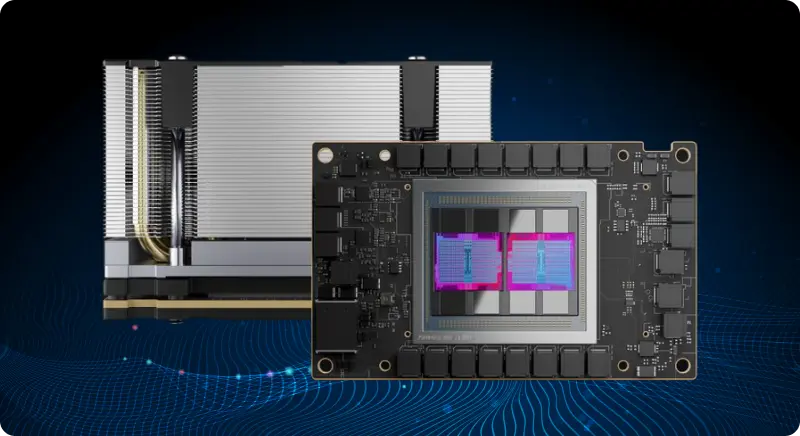

Die CDNA3-Architektur bietet bahnbrechende Rechenleistung für Deep-Learning-Training, LLM-Feinabstimmung und wissenschaftliche Rechenaufgaben, die einen maximalen Durchsatz erfordern.

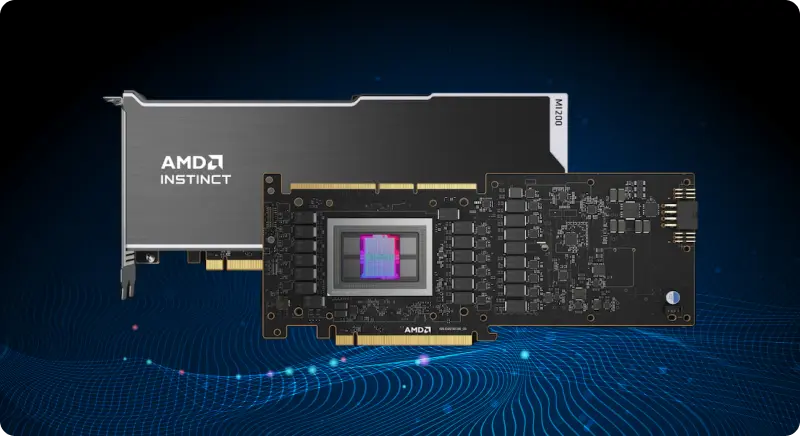

Setzen Sie HPE-Bare-Metal-Server der Enterprise-Klasse mit AMD Instinct-Beschleunigern für Machine Learning, LLM-Inferenz und High-Performance-Computing-Workloads ein.

Entwickelt für künstliche Intelligenz, maschinelles Lernen und den Einsatz großer Sprachmodelle. AMD Instinct GPU-Server kombinieren die CDNA3-Rechenarchitektur mit Zen 4-CPU-Kernen und 192 GB HBM3-Speicher für intensive KI-Trainings-, Inferenz- und HPC-Anwendungen.

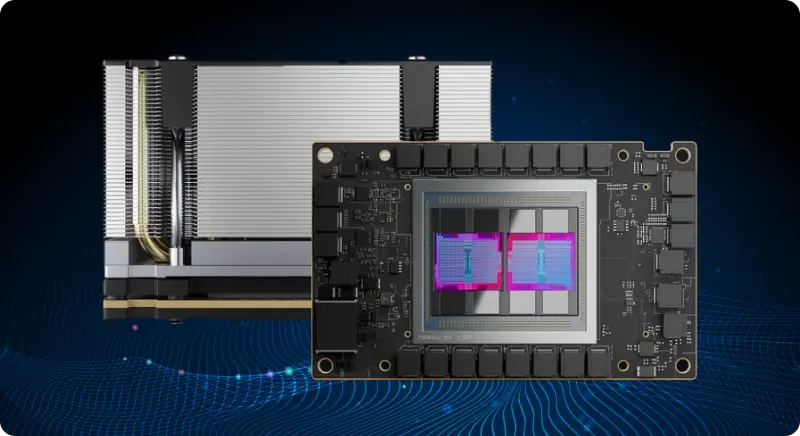

Enterprise-Beschleuniger auf Basis der CDNA-2-Architektur für Exascale-Computing und KI-Workloads

| MI210 | L40S | A100 | H100 | |

|---|---|---|---|---|

| GPU-Architektur | CDNA 2.0 | Ada Lovelace | NVIDIA Ampere | Trichter |

| GPU-Speicher | 64 GB HBM2e | 48 GB GDDR6 | 80 GB HBM2e | 80 GB HBM3 |

| GPU-Speicherbandbreite | 1638 GB/s | 864 GB/s | 1935 GB/s | 3352 GB/s |

| FP32 | 22,63 TFLOPS | 91,6 TFLOPS | 19,5 TFLOPS | 51 TFLOPS |

| TF32 Tensor Core | 312 TFLOPS | 366 TFLOPS | 312 TFLOPS | 756 TFLOPS |

| FP16/BF16 Tensor Core | 181 TFLOPS | 733 TFLOPS | 624 TFLOPS | 1513 TFLOPS |

| Leistung | Bis zu 300 W | Bis zu 350 W | Bis zu 400 W | Bis zu 350 W |

| Laden... | Laden... | Laden... | Laden... |

Hier finden Sie Antworten auf häufig gestellte Fragen zur Bereitstellung und zum Betrieb von AMD Instinct GPU-beschleunigten Bare-Metal-Servern für KI-Training, Inferenz und High-Performance-Computing-Anwendungen.