AMD Instinct GPU sunucuları hakkında sıkça sorulan sorular

Yapay zeka eğitimi, çıkarım ve yüksek performanslı hesaplama uygulamaları için AMD Instinct GPU hızlandırmalı çıplak metal sunucuların dağıtımı ve işletimi hakkında sık sorulan soruların yanıtlarını alın.

AMD Instinct hızlandırıcıları nelerdir ve hangi iş yükleri en çok fayda sağlar?

AMD Instinct hızlandırıcılar, yapay zeka, makine öğrenimi, büyük dil modelleri ve yüksek performanslı hesaplama uygulamaları için tasarlanmış kurumsal düzeyde işlem gücü sağlayan GPU'lardır. Grafik yerine hesaplama için optimize edilmiş CDNA mimarisi üzerine kurulu olan bu işlemciler, derin öğrenme eğitimi ve çıkarımı, bilimsel simülasyonlar, hesaplamalı akışkanlar dinamiği, moleküler modelleme ve büyük paralel işlem gücü gerektiren veri analitiği alanlarında üstün performans gösterirler.

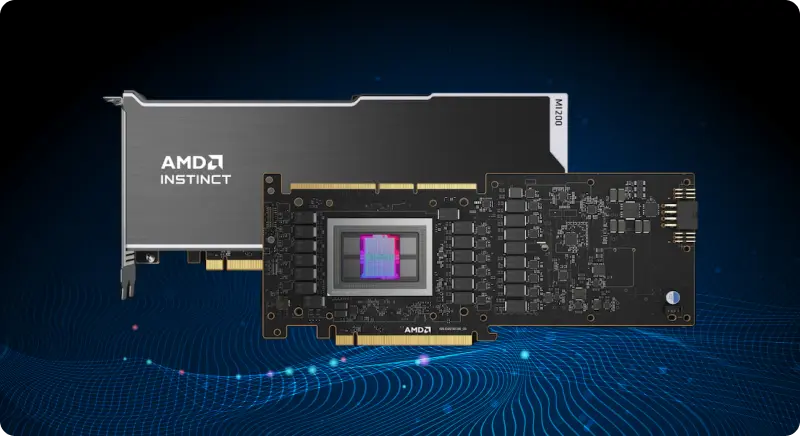

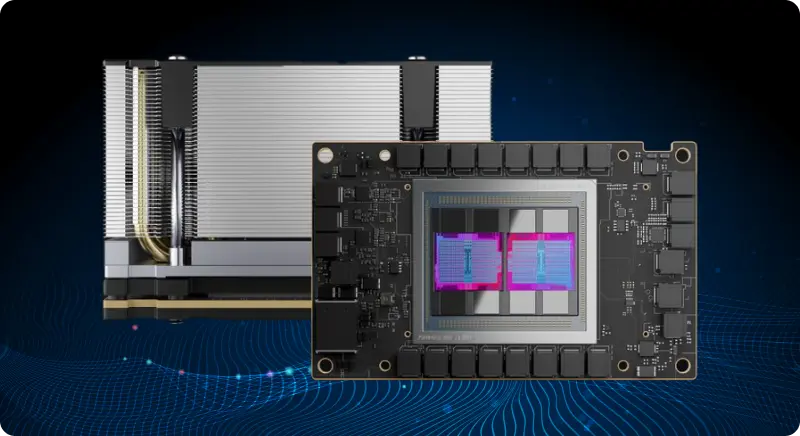

MI300A, MI200 serisi gaz pedallarından nasıl farklıdır?

MI300A, AMD'nin en yeni APU mimarisini temsil eder ve 3. Nesil Infinity Mimarisi ile desteklenen birleşik 192 GB HBM3 bellek alt tabakasında 24 çekirdekli AMD EPYC™ Zen 4 CPU ile AMD Instinct GPU'yu entegre eder. Bu, geleneksel CPU-GPU veri aktarım darboğazlarını ortadan kaldırır. MI200 serisi (MI250X, MI250, MI210), çoklu çip tasarımına sahip 2. Nesil CDNA mimarisine sahip ayrı GPU hızlandırıcılarıdır ve olağanüstü çoklu hızlandırıcı ölçeklenebilirliği için GPU başına 8 adede kadar Infinity Fabric™ bağlantısı sunar.

AMD Instinct sunucularının tipik devreye alma süresi ne kadardır?

Anında teslimat sunucuları, ödeme doğrulamasından sonra genellikle 3-10 dakika içinde devreye alınır. Özel yapılandırmalar, bileşen kullanılabilirliğine bağlı olarak dağıtılır. Tüm AMD Instinct sunucuları, destek talebi gerektirmeden anında işletim sistemi yeniden yüklemeyi destekleyerek hızlı yinelemeyi mümkün kılar. Ağ altyapısı, sürekli yüksek verimlilik gerektiren iş yükleri ve düşük gecikmeli bağlantı için optimize edilmiştir.

AMD Instinct GPU'ları hangi yazılım çerçeveleri ve araçları destekliyor?

AMD Instinct hızlandırıcıları, PyTorch, TensorFlow, JAX, ONNX Runtime ve diğer önde gelen makine öğrenimi çerçevelerini destekleyen açık kaynaklı bir GPU hesaplama platformu olan ROCm (Radeon Open Compute) üzerinde çalışır. ROCm, CUDA kodunun kolayca taşınmasını sağlayan HIP (Heterogeneous-Compute Interface for Portability) ve doğrusal cebir, FFT, rastgele sayı üretimi ve derin sinir ağları için optimize edilmiş kütüphaneler içerir. Docker ve Kubernetes aracılığıyla tam konteyner desteği, üretim ölçeğinde yapay zeka/makine öğrenimi dağıtımını mümkün kılar.

AMD Instinct sunucularında hangi bellek yapılandırmaları mevcuttur?

MI300A APU, hem GPU hem de CPU çekirdeklerine erişilebilen 192 GB birleşik HBM3 (Yüksek Bant Genişliğine Sahip Bellek) sağlayarak, veri yoğun uygulamalar için bellek aktarım yükünü ortadan kaldırır. MI200 serisi hızlandırıcılar, büyük ölçekli sinir ağı eğitimi ve çıkarımı için optimize edilmiş yüksek bant genişliğine sahip HBM2e belleğe sahiptir. Bu önemli bellek kapasitesi, temel modellerin eğitilmesini, kapsamlı veri kümelerinin işlenmesini ve karmaşık simülasyonların ana hızlandırıcı bellek karıştırması olmadan yürütülmesini destekler.