Randament maxim de calcul

Arhitectura CDNA3 oferă performanțe de calcul inovatoare pentru antrenamentul în deep learning, reglajul fin LLM și sarcinile de lucru de calcul științific care necesită randament maxim.

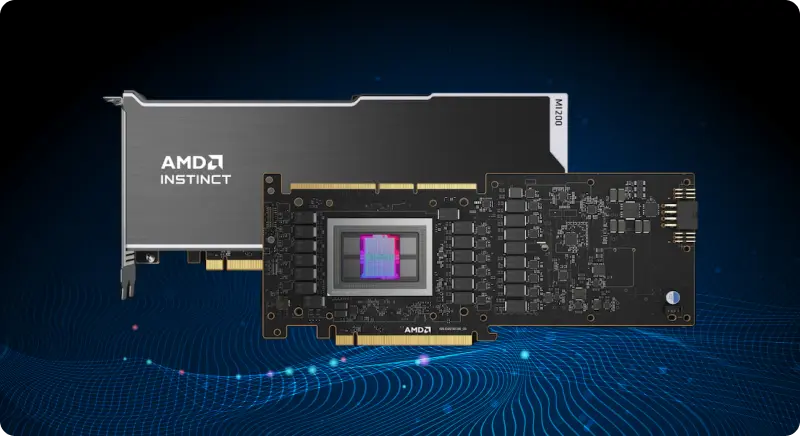

Implementați servere HPE bare metal de nivel enterprise, bazate pe acceleratoare AMD Instinct, pentru învățare automată, inferență LLM și sarcini de lucru de calcul de înaltă performanță.

Proiectate pentru inteligență artificială, învățare automată și implementare de modele lingvistice mari. Serverele GPU AMD Instinct combină arhitectura de calcul CDNA3 cu nuclee CPU Zen 4 și memorie unificată HBM3 de 192 GB pentru antrenament intensiv de inteligență artificială, inferență și aplicații HPC.

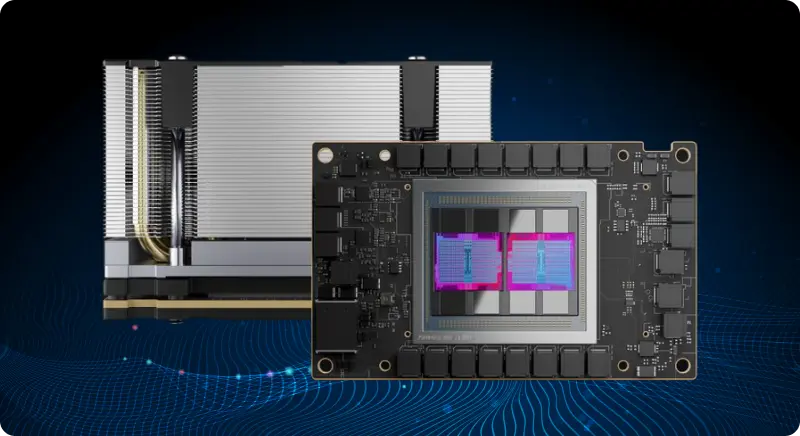

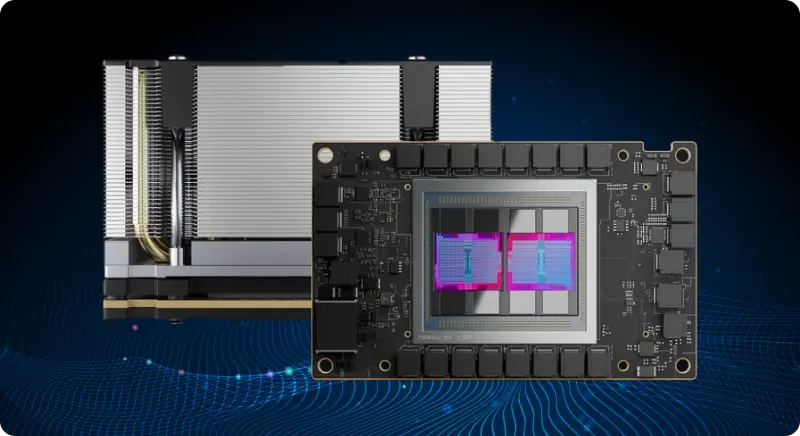

Acceleratoare de nivel enterprise construite pe arhitectura CDNA 2 pentru calcul exascale și sarcini de lucru AI

| MI210 | L40S | A100 | H100 | |

|---|---|---|---|---|

| Arhitectura GPU | ADNc 2.0 | Ada Lovelace | NVIDIA Ampere | Pâlnie |

| Memorie GPU | 64 GB HBM2e | 48 GB GDDR6 | 80 GB HBM2e | 80 GB HBM3 |

| Lățime de bandă a memoriei GPU | 1638 GB/s | 864 GB/s | 1935 GB/s | 3352 GB/s |

| FP32 | 22,63 TFLOPS | 91,6 TFLOPS | 19,5 TFLOPS | 51 TFLOPS |

| Nucleu tensor TF32 | 312 TFLOPS | 366 TFLOPS | 312 TFLOPS | 756 TFLOPS |

| Nucleu tensor FP16/BF16 | 181 TFLOPS | 733 TFLOPS | 624 TFLOPS | 1513 TFLOPS |

| Putere | Până la 300W | Până la 350W | Până la 400W | Până la 350W |

| Încărcare... | Încărcare... | Încărcare... | Încărcare... |

Obțineți răspunsuri la întrebări frecvente despre implementarea și operarea serverelor bare metal accelerate de GPU AMD Instinct pentru antrenament, inferență și aplicații de calcul de înaltă performanță în domeniul inteligenței artificiale.