Servers in stock

Checking availability...

Wdrażaj serwery fizyczne HPE klasy korporacyjnej z akceleratorami AMD Instinct do zadań związanych z uczeniem maszynowym, wnioskowaniem LLM i obliczeniami o wysokiej wydajności.

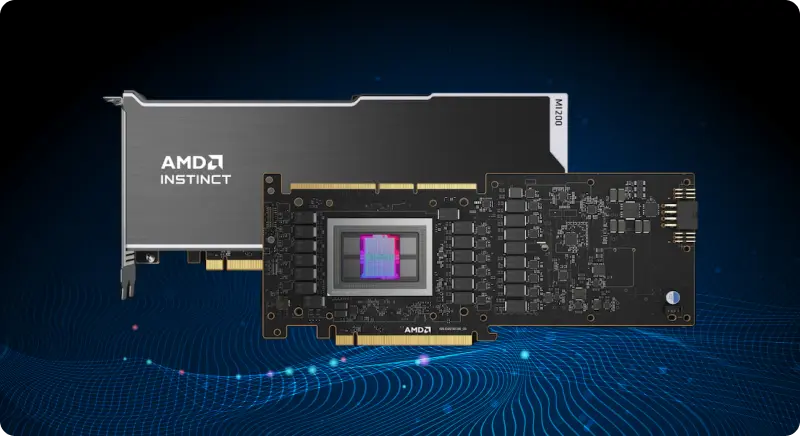

Zaprojektowane z myślą o sztucznej inteligencji, uczeniu maszynowym i wdrażaniu dużych modeli językowych. Serwery GPU AMD Instinct łączą architekturę obliczeniową CDNA3 z rdzeniami procesora Zen 4 i 192 GB zunifikowanej pamięci HBM3, co umożliwia intensywne szkolenie AI, wnioskowanie i aplikacje HPC.

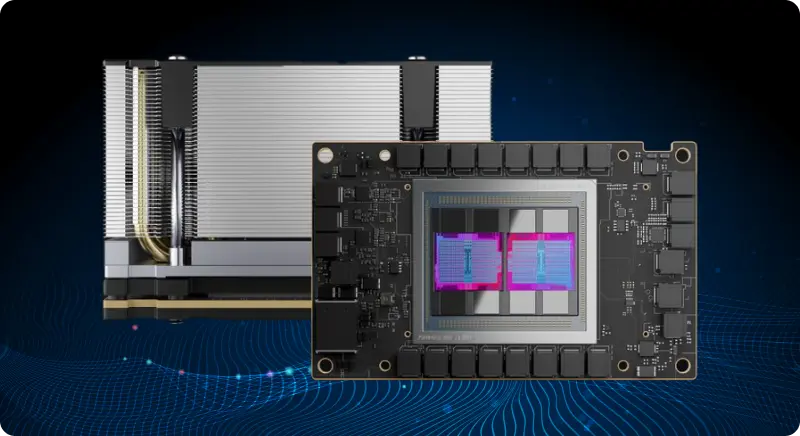

Akceleratory klasy korporacyjnej zbudowane w oparciu o architekturę CDNA 2 do obliczeń eksaskalowych i obciążeń AI

| MI210 | L40S | A100 | H100 | |

|---|---|---|---|---|

| Architektura GPU | CDNA 2.0 | Ada Lovelace | NVIDIA Ampere | Zbiornik |

| Pamięć GPU | 64 GB HBM2e | 48 GB pamięci GDDR6 | 80 GB HBM2e | 80 GB HBM3 |

| Przepustowość pamięci GPU | 1638 GB/s | 864 GB/s | 1935 GB/s | 3352 GB/s |

| FP32 | 22,63 teraflopów | 91,6 teraflopów | 19,5 teraflopów | 51 teraflopów |

| Rdzeń tensorowy TF32 | 312 teraflopów | 366 teraflopów | 312 teraflopów | 756 teraflopów |

| Rdzeń tensorowy FP16/BF16 | 181 teraflopów | 733 teraflopów | 624 teraflopów | 1513 teraflopów |

| Moc | Do 300 W | Do 350 W | Do 400 W | Do 350 W |

| Załadunek... | Załadunek... | Załadunek... | Załadunek... |

Uzyskaj odpowiedzi na często zadawane pytania dotyczące wdrażania i obsługi serwerów bare metal z akceleracją GPU AMD Instinct do celów szkolenia sztucznej inteligencji, wnioskowania i zastosowań wymagających wysokiej wydajności obliczeniowej.